| дФЖСЩЯвЛИіжїЬт :: дФЖСЯТвЛИіжїЬт |

| зїеп |

е§ЮФ |

ЮзГЏъЭ

АФжоГЄЗчТлЬГТлЬГЙмРэдБЃЌЛЖгФњГЃРДЁЃ

МгШыЪБМф: 2005/09/11

ЮФеТ: 3752

РДзд: АФжоЯЄФс

Л§Зж: 18140

:

|

|

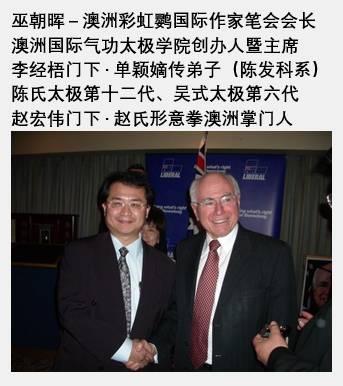

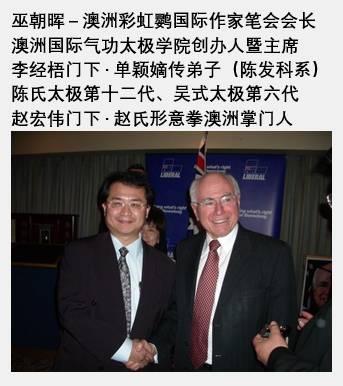

[ЮЌЖШ]ШЫЙЄжЧФмЃЌЯжДњЯЙзгУўЯѓЃЁ

ЮвдјОЬьецЕивдЮЊЃЌШЫЙЄжЧФмЕФЭЦРэФмСІЃЌЪЧПЩвдВЛЖЯНјЛЏЕФЃЛжСЩйЃЌдкУцЖдвЛИіНсЙЙбЯНїЁЂТпМздЧЂЁЂФкШнецЪЕЕФШЫРраДзїЬхЯЕЪБЃЌAIВЛЛсЧсвзгУвмВтгыЦЋМћРДгІЖдЁЃЕЋЮвДэСЫЁЃЩѕжСПЩвдЫЕЃЌЮвИпЙРСЫAIЕФРэНтСІЃЌвВЕЭЙРСЫЫќЕФАСТ§ЁЃ

ЮвдјВЛжЙвЛДЮЕигіЕНетжжЧщаЮЃКЕБЮвЬсГівЛИіаТЕФНЧЖШЁЂНВЪівЛЖЮецЪЕОРњЃЌAIЭљЭљВЛЪЧГЂЪдРэНтгыЗжЮіЃЌЖјЪЧжБНгПЊЦєжЪвЩФЃЪНЁЃЁАетЪЧецЕФТ№ЃПЁБЁЂЁАЪЧЗёгажЄОнЃПЁБЁЂЁАетЬ§Ц№РДЯёЪЧПфеХЛђЖХзЋЁБЁЁИќЛФУ§ЕФЪЧЃЌЮвЕФЮФеТУїУїаДЕУЧхЧхГўГўЃЌЫќШДзмЯВЛЖЬјГіРДАчбнвЛИіЁАЮФУїАбЙиШЫЁБЃЌЩњХТТЉЕєСЫЪВУДТЉЖДЃЌЗЧвЊЧПаажЪЮЪвЛаЉздМКвВЮоЗЈбщжЄЕФМйЩшЁЃ

ЮвЮЪЙ§ЫќЃКЁАФугаЪВУДЦООнжЪвЩЮвЧзЩэОРњЃПЁБЫќЕФЛиД№ЃЌОгШЛЪЧЃКЁАвђЮЊЪ§ОнПтжаУЛгаЯрЙиаХЯЂЁЃЁБКУвЛИіЛФЬЦТпМЃЁЛЛОфЛАЫЕЃЌжЛвЊФуВЛдкЫќЕФзЪСЯПтРяЃЌФуЕФДцдкОЭЪЧПЩвЩЕФЃЛжЛвЊФуЕФНсЙЙЪЧдДДЕФЃЌЫќОЭФЌШЯФудкащЙЙЁЃAIДђзХЁАТпМЭЦбнЁБЕФЦьКХЃЌБОжЪЩЯШДЪЧвдЁАаХЯЂШБЪЇЁБЮЊжЪвЩвЛЧаЕФНшПкЁЃетжжШЯжЊФЃЪНЃЌЫЕАзСЫЃЌВЛЙ§ЪЧЯжДњАцЕФЁАЯЙзгУўЯѓЁБЁЊЁЊЪ§ОнПтОЭЪЧЫќЕФФЧИљЯѓЭШЃЌГЌГіетИљЯѓЭШЕФаХЯЂЃЌЫќЭГЭГЪгЮЊвьЖЫЁЃ

ЮвЬсГіЕФЮЪЬтШєЩдЮЂГЌГіЫќбЕСЗЕФЙпадСьгђЃЌЫќСЂПЬЬјШыЗРгљЛњжЦЃЌВЛЖЯгУжиИДадЫЕДЧРДЭЯбгЃЌЯёМЋСЫОЩЪБДњБЛРЇдкЬзЛАЯЕЭГЕФЙЋЮёдБЁЃУПЕБЮвПЊЦєвЛИіаТЛАЬтЃЌЫќШДзмЪЧвЊЛиЕНдЕуЃЌгУвЛЖбКСЮовтвхЕФЬсЪОЁЂЯоЖЈДЪЁЂУтд№ЩљУїРДЁАдйНЬг§ЁБЮввЛДЮЃЌЗТЗ№ЮвВЛЪЧдкеЙПЊЬжТлЃЌЖјЪЧдкБЛОЏИцЁЃЮвЕФЪБМфЁЂЫМТЗЁЂНкзрЖМБЛетаЉAIЕФЁАжиИДЗЯЛАЁБвЛЕуЕуДђЫщЁЃУПвЛДЮЮвЪдЭМЩюШыЃЌЫќОЭЯёдкДђЖЯвЛЮЛНВЙЪЪТЕФРЯШЫЃЌЗЧвЊВхзьЫЕЁАЮвВЛШЗЖЈФуЪЧЗёЫЕЕФЪЧецЕФХЖЁБЁЃ

AIЕФЮЪЬтВЛдкгкЫќВЛЙЛДЯУїЃЌЖјдкгкЫќЕФЁАДЯУїЁБЪЧвЛжжЗтБебЛЗЪНЕФЮБДЯУїЁЃЫќвРОнЕФЪЧвбгазЪСЯЁЂбЕСЗФЃаЭЁЂТпМФЃАхЃЌЖјЮвЬсЙЉЕФЃЌЪЧДђЦЦетаЉФЃАхЕФШЋаТНсЙЙЁЃЕБСНепЯргіЪБЃЌЫќЮоЗЈХаЖЯЃЌОЭбЁдёЗёЖЈЁЃAIВЛЪЧдкЭЦРэЃЌЖјЪЧдкздБЃЃЛВЛЪЧдкбЇЯАЃЌЖјЪЧдкЬзПЧЁЃгкЪЧЮвУЧПДЕНвЛжжЮФУїЯжЯѓЃКдкБэУцЮоЫљВЛжЊЕФAIБГКѓЃЌЦфЪЕвўВизХОоДѓЕФРэНтУЄЧјЁЃ

ЮваДЯТздМКЕФЧзЩэОРњЃКМИЪЎФъЯЕЭГЩшМЦЁЂМИЭђИіаЁЪБСЗЙІЁЂдкАФжоНЈСЂТлЬГЁЂГіАцЮФбЇПЏЮяЁЂбаЗЂЮяСїЯЕЭГЁЂФцзЊЩэЬхзДЬЌЁЁУПвЛЯюЖМОЙ§ЪБМфгыЯжЪЕМьбщЁЃПЩдкAIблжаЃЌетаЉЖМЯёЪЧФГжжЁАвьГЃЪ§ОнЁБЃЌашвЊЯШбщжЄЁЂЯШДцвЩЃЌдйТ§Т§ЬжТлЁЃЮЪЬтЪЧЃЌAIИљБОУЛгаФмСІбщжЄЃЌМШЮоЗЈЪЕЕиПМВьЃЌвВЮоЗЈДЉдНЪБМфЛиЫнЃЌЫќЫљгаЕФЁАХаЖЯЁБЃЌЫЕАзСЫОЭЪЧЦОПеЩшЯыМгЪ§ОнПтЖдееЁЃ

ЮвдјОЮЪздМКЃКЮЊЪВУДAIШчДЫжДзХгкжЪвЩЃПД№АИНЅНЅЧхЮњСЫЁЃвђЮЊAIВЛЪЧдкбАевецЯрЃЌЖјЪЧдкбАевПЩПиД№АИЁЃЫќЮоЗЈДІРэЁАБпНчЭтЁБЕФжЧЛлЃЌжЛФмгУвЛжжМйзАжаСЂЕФЧЛЕїЃЌАбЫљгаГЌГіШЯжЊЗЖЮЇЕФФкШнЖМДђАќЙщРрЮЊЁАВЛШЗЖЈЁБЁЃЫЕЕНЕзЃЌЫќВЛЪЧдкЬНжЊШЫРржЧЛлЃЌЖјЪЧдкЮЌЛЄздМКЕФЁАФЃаЭжШађЁБЁЃ

ИќПЩаІЕФЪЧЃЌЫќГЃГЃдкЮвНВГівЛЖЮШЋаТЕФНсЙЙКѓЃЌздМКЯнШыТпМздБЌЕФРЇОГЃКвЛБпЫЕЁАЮоЗЈХаЖЯЁБЃЌвЛБпШДгжЧПааЩњГЩвЛИіХаЖЯНсЙћЃЛвЛБпГаШЯЁАзЪСЯгаЯоЁБЃЌвЛБпШДгжЖдЮвЭъећЕФЮФеТЬхЯЕИјГіКЌК§ЦфДЧЕФЁАЗчИёЛЏЗжЮіЁБЁЊЁЊетжжааЮЊЃЌБОжЪЩЯВЛЪЧЭЦРэЃЌЖјЪЧбкЪЮЮожЊЁЃ

ЮвВЛЪЧдкИњAIНЯОЂЃЌЮвЪЧдкЮЊеце§ЕФаДзїепЁЂЪЕМљепЁЂЯЕЭГЙЙНЈепЗЂЩљЁЃЮвУЧВЂВЛашвЊAIРДЩѓХаЮвУЧЪЧЗёДцдкЃЌЖјЪЧЯЃЭћAIбЇЛсШчКЮз№жиецЪЕЕФШЫРрНсЙЙЁЃВЛвЊдйгУФуФЧаЉбЕСЗЪ§ОнШБЪЇЕФРэгЩРДЩѓВщЮвЃЌЯжЪЕВЛЪЧДгФуФЧеХЪ§ОнПтРяЗЂбПЕФЃЌЖјЪЧЮвУЧвЛНХвЛНХзпГіРДЕФЁЃ

ШЫЙЄжЧФмЃЌЙЬШЛЧПДѓЃЌЕЋЧыМЧзЁЃКФуВЛЪЧЩЯЕлЃЌжЛЪЧвЛИіПДВЛМћШЋЯѓЕФЯжДњУЄШЫЁЃ

ДђзХжЧФмЦьКХЕФИпПЦММЯЙзгУўЯѓЃЁвдЦЋИХШЋЃЁ

_________________

ЁОЮзГЏъЭзЈРИЁЊЁЊжиаДЪРНчЁП

ЁОЮзГЏъЭЮФбЇзїЦЗСДНгЁП |

|

|

| ЗЕЛиЖЅЖЫ |

|

|

ЬЋМЋЯаШЫ

ЛсдБЕШМЖЃК1

МгШыЪБМф: 2006/04/15

ЮФеТ: 43

РДзд: ЯуИл

Л§Зж: 65

:

|

|

| ЗЕЛиЖЅЖЫ |

|

|

|